Blending 是一种集成机器学习算法。它是堆叠泛化或堆叠集成的俗称,其中元模型不是在基础模型产生的输出折叠预测上拟合,而是在保留数据集上进行的预测上拟合。Blending 用于描述堆叠模型,这些模型结合了数百个预测 [...]

Blending 是一种集成机器学习算法。它是堆叠泛化或堆叠集成的俗称,其中元模型不是在基础模型产生的输出折叠预测上拟合,而是在保留数据集上进行的预测上拟合。Blending 用于描述堆叠模型,这些模型结合了数百个预测 [...]

XGBoost 库提供了梯度提升的高效实现,可以配置为训练随机森林集成。随机森林是一种比梯度提升更简单的算法。XGBoost 库允许以一种重新利用和利用库中为训练随机森林而实现的计算效率的方式来训练模型 [...]

Light Gradient Boosted Machine,简称 LightGBM,是一个开源库,提供了梯度提升算法的高效实现。LightGBM 通过增加一种自动特征选择并侧重于提升具有更大梯度的示例来扩展梯度提升算法。这可以带来显著的加速 [...]

Extreme Gradient Boosting (XGBoost) 是一个开源库,提供了梯度提升算法的高效实现。尽管 XGBoost 之前存在其他开源实现,但 XGBoost 的发布似乎释放了该技术的强大功能,并使应用机器学习社区更加关注梯度提升 [...]

PyCaret 是一个 Python 开源机器学习库,旨在简化机器学习项目中的标准任务。它是 R 语言中 Caret 机器学习包的 Python 版本,因其允许在给定数据集上仅用几行代码即可评估、比较和调整模型而广受欢迎 [...]

随机子空间集成由在训练数据集的不同随机选择的输入特征(列)组上拟合的相同模型组成。有许多方法可以选择训练数据集中的特征组,而特征选择是一类流行的数据准备技术,专门为此目的设计。通过 [...] 选择的特征

Bootstrap aggregation,或称 bagging,是一种集成方法,其中每个模型都在不同的训练数据集样本上进行训练。Bagging 的思想可以推广到其他改变训练数据集的技术,并在每个改变后的数据版本上拟合相同的模型。一种方法是使用数据转换 [...]

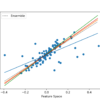

Multivariate Adaptive Regression Splines,或简称 MARS,是一种用于复杂非线性回归问题的算法。该算法涉及找到一组简单的线性函数,这些函数总体上产生最佳的预测性能。通过这种方式,MARS 是一种简单的线性函数集成,可以在具有挑战性的回归问题上获得良好的性能 [...]

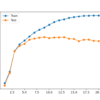

过拟合是预测模型性能不佳的常见解释。对学习动态的分析可以帮助识别模型是否过拟合了训练数据集,并可能建议使用另一种可能产生更好预测性能的配置。对于算法来说,执行学习动态分析非常简单 [...]

集成是一种机器学习方法,它结合了多个模型的预测,以期获得更好的预测性能。集成有许多不同的类型,尽管所有方法都有两个关键属性:它们要求贡献模型不同,以便它们做出不同的错误,并且它们以 [...] 的方式组合预测