许多不平衡分类任务需要一个能够预测清晰类别标签的熟练模型,其中两个类别同等重要。需要类别标签且两个类别同等重要的不平衡分类问题的一个例子是检测卫星图像中的石油泄漏或油膜。泄漏的检测 [...]

许多不平衡分类任务需要一个能够预测清晰类别标签的熟练模型,其中两个类别同等重要。需要类别标签且两个类别同等重要的不平衡分类问题的一个例子是检测卫星图像中的石油泄漏或油膜。泄漏的检测 [...]

开发概率模型通常具有挑战性,尽管当案例分布存在偏差(称为不平衡数据集)时,情况会更加如此。Haberman 数据集描述了 20 世纪 50 年代和 60 年代乳腺癌患者的五年或更长时间的生存情况,并且大部分患者都能存活。 [...]

不平衡分类作为一项预测建模任务,主要挑战在于类别分布严重偏斜。这是传统机器学习模型和假设类别分布平衡的评估指标表现不佳的原因。尽管如此,分类数据集还有一些其他属性,它们不仅对预测建模具有挑战性 [...]

异常值或离群点是不符合其余数据的稀有样本。识别数据中的异常值称为异常值或离群点检测,而专注于此问题的机器学习子领域称为单类分类。这些是无监督学习算法,试图对“正常” [...]

Bagging 是一种集成算法,它在训练数据集的不同子集上拟合多个模型,然后组合所有模型的预测。随机森林是 Bagging 的扩展,它还随机选择每个数据样本中使用的特征子集。Bagging 和随机森林在各种 [...]

分类预测建模通常涉及预测类别标签。然而,许多机器学习算法能够预测类成员资格的概率或得分,并且在将其映射到清晰类别标签之前必须对其进行解释。这是通过使用阈值实现的,例如 0.5,其中所有等于或 [...]

大多数机器学习算法都假设模型产生的所有误分类错误都是相等的。对于不平衡分类问题,情况通常并非如此,因为漏掉一个正类或少数类样本比错误地将一个来自负类或多数类的样本分类更糟糕。有很多现实世界的例子,例如检测垃圾邮件 [...]

XGBoost 算法对于各种回归和分类预测建模问题都有效。它是随机梯度提升算法的一个高效实现,并提供了一系列超参数,可以对模型训练过程进行精细控制。尽管该算法在一般情况下表现良好,即使在不平衡分类数据集上也是如此,但它 [...]

深度学习神经网络是一类灵活的机器学习算法,在各种问题上表现良好。神经网络使用误差反向传播算法进行训练,该算法涉及计算模型在训练数据集上产生的误差,并根据这些误差更新模型权重。局限性 [...]

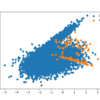

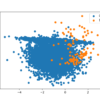

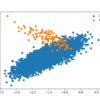

支持向量机算法对于平衡分类是有效的,尽管它在不平衡数据集上的表现不佳。SVM 算法找到一个超平面决策边界,该边界最好地将样本分成两类。通过使用允许某些点被错误分类的裕度,该分割被软化。默认情况下, [...]