决策树算法对于平衡分类很有效,但它在不平衡数据集上表现不佳。树的分割点选择是为了最好地将示例分成两组,同时最大程度地减少混合。当两个组都由某一类别的示例主导时,用于选择分割点的标准将 […]

决策树算法对于平衡分类很有效,但它在不平衡数据集上表现不佳。树的分割点选择是为了最好地将示例分成两组,同时最大程度地减少混合。当两个组都由某一类别的示例主导时,用于选择分割点的标准将 […]

逻辑回归不直接支持不平衡分类。相反,用于拟合逻辑回归模型的训练算法必须进行修改,以考虑倾斜的分布。这可以通过指定一个类别加权配置来实现,该配置用于影响逻辑回归系数在训练期间的更新量。 […]

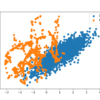

在类别分布不平衡的分类数据集上,机器学习技术常常会失效或给出误导性的乐观性能。原因是许多机器学习算法被设计用于处理每个类别具有相等数量观测值的分类数据。当情况并非如此时,算法会学习到只有很少的示例 […]

重采样方法旨在向训练数据集中添加或删除示例,以改变类别分布。一旦类别分布更加平衡,就可以在转换后的数据集上成功拟合一套标准的机器学习分类算法。过采样方法通过复制或创建少数类的新合成示例来 […]

重采样方法旨在改变不平衡分类任务的训练数据集的组成。重采样方法在不平衡分类中的注意力大多放在少数类过采样上。尽管如此,已经开发了一套用于多数类欠采样的方法,这些方法可以与有效的 […] 结合使用。

不平衡分类涉及在类别严重不平衡的分类数据集上开发预测模型。处理不平衡数据集的挑战在于,大多数机器学习技术都会忽略少数类,并且在少数类上的性能也较差,尽管通常少数类上的性能是最重要的。一种方法 […]

不平衡分类速成课程。7 天掌握不平衡分类。分类预测建模是将标签分配给示例的任务。不平衡分类是指类别示例分布不相等的分类任务。实际的不平衡分类需要使用一套专门的技术 […]

不平衡数据集是指类别分布严重倾斜的数据集,例如少数类与多数类的示例比例为 1:100 或 1:1000。训练数据集中的这种偏差会影响许多机器学习算法,导致一些算法完全忽略少数类。这是一个问题,因为 […]

初学者常犯的一个错误是在没有建立性能基线的情况下将机器学习算法应用于问题。性能基线提供了一个最低分数,模型在此分数之上才被认为在该数据集上具有技能。它还为在数据集上评估的所有模型提供了一个相对改进的点。 […]

模型评估涉及使用可用数据集来拟合模型,并估计其在对未见过示例进行预测时的性能。这是一个挑战性问题,因为用于拟合模型的训练数据集和用于评估它的测试集都必须足够大,并且能代表潜在问题,因此 […]