函数优化是指找到使目标函数获得最优值的输入。优化算法在输入变量的搜索空间中导航,以定位最优解。在实际问题中,目标函数的形状以及算法在搜索空间中的行为都是不透明的。因此,[…]

函数优化是指找到使目标函数获得最优值的输入。优化算法在输入变量的搜索空间中导航,以定位最优解。在实际问题中,目标函数的形状以及算法在搜索空间中的行为都是不透明的。因此,[…]

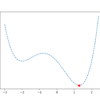

梯度下降是一种优化算法,它沿着目标函数的负梯度方向移动,以找到函数的最小值。梯度下降的一个局限性是,所有输入变量都使用相同的步长(学习率)。像 AdaGrad 和 RMSProp 这样的梯度下降的扩展会更新算法以[…]

优化是一个数学领域,关注于在众多候选解中找到一个好的或最优的解。它是机器学习中的一个重要基础主题,因为大多数机器学习算法都是使用优化算法在历史数据上进行拟合的。此外,更广泛的问题,例如模型选择和超参数调优,也可以被构建为[…]

如何优化一个单变量函数?单变量函数优化是指找到使目标函数获得最优输出的输入。这是机器学习中一个常见的过程,用于拟合具有单个参数的模型或调优具有单个超参数的模型。一种高效的算法[…]

应用机器学习通常侧重于找到一个在给定数据集上表现良好或最佳的单一模型。有效使用该模型需要对输入数据进行适当的准备以及对模型进行超参数调优。总的来说,准备数据、调优模型和转换所需的线性步骤序列[…]

半监督学习是指试图同时利用标记和未标记训练数据的算法。半监督学习算法与只能从标记训练数据中学习的有监督学习算法不同。半监督学习的一种流行方法是创建一个图,连接训练数据集中的样本并传播[…]

多项逻辑回归是逻辑回归的扩展,它增加了对多类分类问题的原生支持。逻辑回归默认仅限于二分类问题。像一对多这样的扩展可以允许逻辑回归用于多类分类问题,尽管它们要求首先将分类问题转换为多个二元[…]

半监督学习是指试图同时利用标记和未标记训练数据的算法。半监督学习算法与只能从标记训练数据中学习的有监督学习算法不同。半监督学习的一种流行方法是创建一个图,连接训练数据集中的样本并传播[…]

梯度提升是决策树算法的集成。鉴于它在各种数据集上表现出色,它可能是用于结构化(表格)分类和回归预测建模问题的最流行技术之一。梯度提升的一个主要问题是训练速度慢[…]

通常,通过从训练数据集中移除输入特征(列)可以开发出更简单、性能更好的机器学习模型。这称为特征选择,并且有许多不同类型的算法可供使用。可以将特征选择问题构建为优化问题。在[…]的情况下