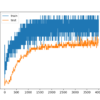

训练神经网络的一个主要挑战是如何确定训练时长。训练不足会导致模型在训练集和测试集上都欠拟合。训练过度会导致模型过拟合训练数据集,在测试集上表现不佳。折衷的办法是训练……

训练神经网络的一个主要挑战是如何确定训练时长。训练不足会导致模型在训练集和测试集上都欠拟合。训练过度会导致模型过拟合训练数据集,在测试集上表现不佳。折衷的办法是训练……

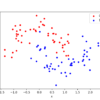

Dropout 正则化是一种计算成本低廉的深度神经网络正则化方法。Dropout 的工作原理是通过概率性地移除或“丢弃”层中的输入,这些输入可能是数据样本中的输入变量,也可能是来自前一层的激活。它的效果是模拟大量的具有不同网络结构的神经网络……

深度学习神经网络很容易在只有少量样本的训练数据集上过拟合。具有不同模型配置的神经网络集成已知可以减少过拟合,但需要额外计算成本来训练和维护多个模型。可以使用单个模型来模拟大量不同的网络……

激活正则化提供了一种方法,可以鼓励神经网络学习稀疏的特征或原始观测的内部表示。在自编码器(称为稀疏自编码器)和编码器-解码器模型中,通常会寻求稀疏学习的表示,尽管该方法也可以普遍用于减少过拟合和提高模型的泛化能力……

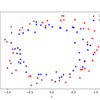

深度学习模型能够从原始输入数据中自动学习丰富的内部表示。这被称为特征或表示学习。更好的学习表示反过来可以带来对领域的更深入理解(例如,通过可视化学习到的特征),并产生利用这些学习到的特征的更好的预测模型。一个……

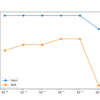

权重约束提供了一种方法,可以减少深度学习神经网络模型在训练数据上的过拟合,并提高模型在新数据(如保留测试集)上的性能。权重约束有多种类型,例如最大范数和单位向量范数,其中一些需要一个超参数……

权重正则化方法(如权重衰减)在训练神经网络时会向损失函数添加惩罚项,以鼓励网络使用较小的权重。神经网络中使用较小的权重可以使模型更稳定,并且不太可能过拟合训练数据集,从而在……上获得更好的性能。

权重正则化提供了一种方法,可以减少深度学习神经网络模型在训练数据上的过拟合,并提高模型在新数据(如保留测试集)上的性能。权重正则化有多种类型,例如 L1 和 L2 向量范数,每种类型都需要一个超参数……

神经网络会学习一组最能将输入映射到输出的权重。具有大网络权重的网络可能是网络不稳定的迹象,此时输入的小变化可能导致输出的大变化。这可能表明网络过拟合了训练数据集,并且……

通常,我们无法使用深度学习方法执行网格搜索。这是因为深度学习方法通常需要大量数据和大型模型,导致模型训练需要数小时、数天甚至数周。在数据集较小的情况下(例如单变量时间序列),……