在处理序列或时间序列数据时,传统的前馈网络无法用于学习和预测。需要一种机制来保留过去或历史信息以预测未来值。循环神经网络(RNN)是传统前馈人工神经网络的一个变体,可以处理序列数据 […]

在处理序列或时间序列数据时,传统的前馈网络无法用于学习和预测。需要一种机制来保留过去或历史信息以预测未来值。循环神经网络(RNN)是传统前馈人工神经网络的一个变体,可以处理序列数据 […]

Luong 注意力机制旨在对神经机器翻译的 Bahdanau 模型进行多项改进,尤其引入了两种新的注意力机制:一种全局方法,关注所有源单词;一种局部方法,在预测目标句子时仅关注部分选定的单词。在此教程中 […]

传统的编码器-解码器机器翻译架构将每个源句子编码为一个固定长度的向量,无论其长度如何,然后解码器再从中生成翻译。这使得神经网络难以处理长句子,实际上导致了性能瓶颈。Bahdanau 注意力机制的提出是为了解决性能 […]

深度学习网络在过去几年中获得了巨大的普及。“注意力机制”已集成到深度学习网络中以提高其性能。在网络中添加注意力组件已被证明在机器翻译、图像识别、文本摘要和类似应用等任务中取得了显著的改进。本教程展示了如何添加 […]

赞助帖子 报名参加 Doug Turnbull 的独家直播课程,将于 10 月 11 日开始。之前的 Sphere 课程学员来自 Apple、Amazon、Spotify、Microsoft、Twitter、Shopify、Glassdoor 等公司。Doug 领导 Shopify 的整个搜索相关性实践。他在过去 10 多年里撰写了行业领先的书籍,例如《Relevant Search》(2016) […]

随着注意力机制在机器学习中的普及程度不断提高,结合了注意力机制的神经网络架构列表也在不断增长。在本教程中,您将发现与注意力机制结合使用的重要神经网络架构。完成本教程后,您将更好地理解注意力机制如何融入不同的 […]

引入注意力机制是为了提高编码器-解码器模型在机器翻译中的性能。注意力机制的理念是通过对所有编码的输入向量进行加权组合,允许解码器以灵活的方式利用输入序列中最相关部分,其中最相关 […]

注意力机制在机器学习中的普及程度越来越高,但是什么让它如此吸引人?在人工神经网络中应用的注意力与生物学上的注意力之间有什么关系?在机器学习中,人们会期望注意力机制系统由哪些组成部分构成?在本教程中,您将了解注意力的概述和 […]

注意力是跨越多个学科(包括心理学、神经科学以及最近的机器学习)进行科学研究的概念。尽管所有学科可能都对注意力给出了自己的定义,但它们都可以就注意力是使生物和人工神经网络系统更具灵活性的机制这一核心特质达成一致。在 […]

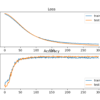

一旦拟合了深度学习神经网络模型,就必须在测试数据集上评估其性能。这一点至关重要,因为报告的性能不仅允许您在候选模型之间进行选择,还可以向利益相关者传达模型在解决问题方面的表现。Keras 深度学习 API 模型是 […]