不可否认,微积分是一门困难的学科。但是,如果你学好了基础知识,你不仅能够掌握更复杂的概念,还会觉得它们很有趣。要理解机器学习算法,你需要理解诸如函数梯度、矩阵海森矩阵和优化等概念,……

不可否认,微积分是一门困难的学科。但是,如果你学好了基础知识,你不仅能够掌握更复杂的概念,还会觉得它们很有趣。要理解机器学习算法,你需要理解诸如函数梯度、矩阵海森矩阵和优化等概念,……

我们之前已经看到,微积分是机器学习中的核心数学概念之一,它使我们能够理解不同机器学习算法的内部工作原理。而微积分又建立在代数和几何的几个基本概念之上。拥有这些基础知识的重要性将更加明显……

微积分是机器学习中的核心数学概念之一,它使我们能够理解不同机器学习算法的内部工作原理。微积分在机器学习中的一个重要应用是梯度下降算法,该算法与反向传播一起,使我们能够训练神经网络模型。在本教程中,……

变化率的测量是微分学中的一个重要概念,它关注变化和无穷小的数学。它使我们能够找到两个变化变量之间的关系以及它们如何相互影响。变化率的测量对于机器学习也很重要,例如在……

微积分是对变化的研究。微积分解决复杂但连续问题的有效性在于它能够将问题分解成无数个更简单的部分,单独解决它们,然后将它们重新组合成原始的整体。这种策略可以应用于研究所有可以被分割的连续元素……

差分进化是一种用于非线性、不可微连续空间函数全局优化的启发式方法。差分进化算法属于更广泛的进化计算算法家族。与其他流行的直接搜索方法,如遗传算法和进化策略类似,差分进化算法以初始种群开始……

本教程介绍了数据科学和自动化学习中的两个重要概念。一是机器学习管道,二是其优化。这两个原则是实现任何基于机器学习的成功智能系统的关键。机器学习管道可以通过将涉及的步骤序列组合在一起而创建……

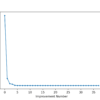

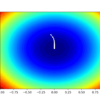

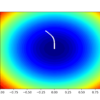

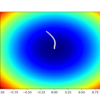

梯度下降是一种优化算法,它沿着目标函数的负梯度方向移动,以找到函数的最小值。梯度下降的一个限制是它对每个输入变量使用相同的步长(学习率)。这对于目标函数具有不同数量的……

梯度下降是一种优化算法,它沿着目标函数的负梯度方向移动,以找到函数的最小值。梯度下降的一个限制是它对所有输入变量使用单一的步长(学习率)。梯度下降的扩展,例如自适应移动估计(Adam)算法,使用……

梯度下降是一种优化算法,它沿着目标函数的负梯度方向移动,以找到函数的最小值。梯度下降的一个限制是它对所有输入变量使用单一的步长(学习率)。梯度下降的扩展,例如自适应移动估计(Adam)算法,使用……