分类预测建模通常涉及预测类标签。尽管如此,许多机器学习算法都能够预测概率或类成员资格评分,在将其映射到明确的类标签之前必须对其进行解释。这通过使用阈值来实现,例如 0.5,其中所有值等于或 […]

分类预测建模通常涉及预测类标签。尽管如此,许多机器学习算法都能够预测概率或类成员资格评分,在将其映射到明确的类标签之前必须对其进行解释。这通过使用阈值来实现,例如 0.5,其中所有值等于或 […]

大多数机器学习算法假设模型所做的所有误分类错误都是相等的。对于不平衡分类问题,这通常不是情况,因为遗漏正例或少数类案例比错误地将示例从负类或多数类中分类更糟糕。有很多现实世界的例子,例如检测垃圾邮件 […]

XGBoost 算法对于各种回归和分类预测建模问题都非常有效。它是随机梯度提升算法的高效实现,并提供一系列超参数,可对模型训练过程进行精细控制。尽管该算法在一般情况下表现良好,即使在不平衡分类数据集上也是如此,但它 […]

深度学习神经网络是一类灵活的机器学习算法,在各种问题上都表现出色。神经网络使用误差反向传播算法进行训练,该算法包括计算模型在训练数据上的误差,并根据这些误差更新模型权重。局限性 […]

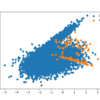

支持向量机算法对于平衡分类是有效的,尽管它在不平衡数据集上表现不佳。SVM 算法找到一个最佳将样本分成两类的超平面决策边界。通过使用允许一些点被错误分类的边距,该分割被软化。默认情况下,[…]

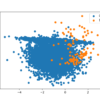

决策树算法对于平衡分类是有效的,尽管它在不平衡数据集上表现不佳。树的分裂点选择为将样本最佳地分成两组,并最小化混合。当两组都以某一类的样本为主时,用于选择分裂点的准则将 […]

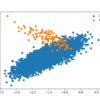

逻辑回归不直接支持不平衡分类。相反,用于拟合逻辑回归模型的训练算法必须进行修改,以考虑偏斜的分布。这可以通过指定类权重配置来实现,该配置用于影响逻辑回归系数在训练期间的更新量。 […]

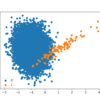

机器学习技术在具有不平衡类分布的分类数据集上常常会失败或给出误导性的乐观性能。原因是许多机器学习算法旨在处理每个类别具有相等数量观测值的分类数据。当不是这种情况时,算法会学习到很少的示例 […]

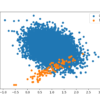

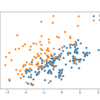

重采样方法旨在从训练数据集中添加或删除示例,以改变类分布。一旦类分布更加平衡,就可以在转换后的数据集上成功拟合一系列标准的机器学习分类算法。过采样方法会在少数类中复制或创建新的合成示例, […]

重采样方法旨在改变不平衡分类任务的训练数据集的构成。不平衡分类的重采样方法大多关注过采样少数类。尽管如此,已经开发了一系列用于欠采样多数类的技术,这些技术可以与有效的 […] 结合使用。