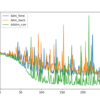

序列预测问题是利用历史序列信息来预测序列中的下一个值或值。序列可以是句子中的字母等符号,也可以是价格时间序列中的真实值。在时间序列的上下文中,序列预测可能最容易理解 […]

序列预测问题是利用历史序列信息来预测序列中的下一个值或值。序列可以是句子中的字母等符号,也可以是价格时间序列中的真实值。在时间序列的上下文中,序列预测可能最容易理解 […]

机器学习算法无法直接处理类别数据。类别数据必须转换为数字。当您处理序列分类类型问题并计划使用深度学习方法(如长短期记忆循环神经网络)时,这一点适用。在本教程中,您将发现如何转换您的输入或 […]

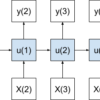

循环神经网络(RNN)是一种人工神经网络,它向网络添加额外的权重以在网络图中创建循环,从而维护内部状态。向神经网络添加状态的承诺是,它们将能够明确地学习和利用上下文 […]

编码器-解码器架构之所以流行,是因为它在各种领域都取得了最先进的结果。该架构的一个局限性是将输入序列编码为固定长度的内部表示。这限制了可以合理学习的输入序列的长度,并导致非常[…] 输入序列的性能变差。

循环神经网络能够学习序列预测问题中跨越多个时间步的时间依赖性。现代循环神经网络,如长短期记忆(LSTM)网络,使用反向传播算法的变体进行训练,称为随时间反向传播。为了提高序列预测问题的效率,该算法已进一步修改[…]

长短期记忆(LSTM)循环神经网络能够学习和记住长序列输入。如果您的问题的每个输入都有一个输出,例如时间序列预测或文本翻译,LSTM 会非常有效。但是,当您有非常长的输入序列并且只有 […] 时,使用 LSTM 可能会很困难。

随时间反向传播(BPTT)是用于更新 LSTM 等循环神经网络权重的训练算法。要有效地为循环神经网络构建序列预测问题,您必须深刻理解随时间反向传播的作用以及截断随时间反向传播等可配置的变体将如何影响 […]

深度学习库假定数据是矢量化的。对于变长序列预测问题,这要求转换数据,使每个序列具有相同的长度。这种矢量化允许代码为您的选择的深度学习算法有效地批量执行矩阵运算。在本教程中 […]

双向 LSTM 是传统 LSTM 的扩展,可以提高模型在序列分类问题上的性能。在输入序列的所有时间步都可用的问题中,双向 LSTM 训练两个 LSTM 而不是一个。第一个在输入序列上按原样训练,第二个在反向副本上训练 […]

长短期记忆(LSTM)循环神经网络的一个强大特性是它们可以在长序列间隔内记住观察结果。这可以通过设计一个简单的序列回显问题来证明,在该问题中,整个输入序列或输入序列的部分连续块被回显为输出序列。开发 LSTM 循环神经 […]